Intelligenza artificiale e l'etica impossibile: tra curiosità e anestesia cognitiva

L'intelligenza artificiale non può generare etica, prerogativa umana che richiede scelta e sacrificio. Mentre l'81% degli utenti la usa per compiti banali come cucina o relazioni, emergono due classi cognitive: gli *architetti del pensiero*, che sfruttano l'IA per esplorare complessità, e gli *esecutori di risposte*, che ne diventano dipendenti. Il *critical prompting* potrebbe essere l'antidoto, ma il rischio è una società divisa tra curiosità e anestesia cognitiva.

L’Intelligenza artificiale (IA) non può generare etica dal nulla. L’etica è una prerogativa umana perché richiede scelta e sacrificio, due concetti che un software non può conoscere. La stessa IA scrive: L’IA può fornire la mappa e la bussola, ma il coraggio di camminare verso l’altro è un muscolo che solo l’uomo può allenare.

E allora vediamo come vanno i muscoli degli utenti.

Consumismo e dipendenza algoritmica

La maggior parte degli utenti interagisce con l’IA per questioni personali o banali, ma i dati indicano che sta emergendo una divisione netta tra l’uso ricreativo/emotivo e l’uso funzionale/informativo.

Secondo i dati di quest’anno, l‘81% degli utenti dichiara di usare l’IA generativa principalmente per compiti personali. Le categorie più frequenti sono: cucina e diete (45%), consigli sulle relazioni (34%) e supporto di tipo terapeutico/motivazionale (23%)1. Molte persone cercano nell’IA uno specchio per i propri dubbi quotidiani o un assistente per piccole incombenze (scrivere email, post social, o pianificare viaggi).

L‘81%! Una percentuale che quasi coincide con la stupidità umana! La cucina e simili sono quelle cose che danno il segno della liberazione della donna, nel senso del consumismo neoliberista! Ma non ci basta la televisione che offre gare di cuochi, di arredamento, di balli sotto le stelle, di aperitivi, di personaggi la cui gaytudine è un condimento fondamentale?

Quanto costa mantenere questo mondo che non si è liberato dalla dipendenza dalla propria madre?

Il paradosso ecologico e umano dell’IA

La produzione dell’energia e delle infrastrutture necessarie per l’IA comporta costi ecologici elevati e gravi problematiche di sfruttamento umano, creando un paradosso tra innovazione tecnologica e sostenibilità. Si stima che il consumo elettrico dei data center possa più che raddoppiare entro il 2030, arrivando a circa 945 TWh, pari a circa il 3% della domanda elettrica mondiale2.

L’addestramento di un singolo modello di IA avanzato può emettere oltre 280 tonnellate di CO2, equivalenti alle emissioni di cinque automobili durante il loro intero ciclo di vita3. L’energia utilizzata proviene spesso da fonti fossili, contribuendo in modo significativo al riscaldamento globale.

I data center richiedono immense quantità di acqua per il raffreddamento dei server. La formazione di GPT-3 ha consumato circa 700.000 litri di acqua, e si stima che tra 10 e 50 risposte di una chat con l’IA consumino circa 500 ml di acqua4. Con tutto il disastro idrico cui il mondo va incontro!

L’obsolescenza rapida dei server e delle GPU (unità di elaborazione grafica) specializzate genera una crescente quantità di rifiuti elettronici (e-waste), stimata tra 1,2 e 5 milioni di tonnellate entro il 20305. Beh, potremmo sempre seppellirli nelle terre dei fuochi o nel mare profondo o, magari, inviarli in Africa!

La produzione di hardware per l’IA richiede materiali rari come cobalto e rame. In particolare, la Repubblica Democratica del Congo, principale fornitore di cobalto, è teatro di sfruttamento lavorativo, inclusi casi documentati di lavoro minorile e forzato in condizioni pericolose. I minatori spesso lavorano per salari miseri, esponendosi a rischi per la salute e la sicurezza senza tutele adeguate6. L’estrazione e la lavorazione di questi minerali causano inquinamento chimico che danneggia la salute delle comunità locali e contamina le risorse idriche7.

Una singola richiesta a un’IA generativa consuma circa 10 volte più energia rispetto a una normale ricerca su Google8. Il buon vecchio Google! Ma anche lui a consumo di energia non scherza!

Aziende del settore stanno costruendo nuove turbine a gas per alimentare i data center, aumentando l’inquinamento atmosferico locale, ad esempio a Memphis, nel Tennessee, dove il supercomputer Colossus di xAI ha operato fino a trentacinque turbine a gas senza autorizzazione ai sensi del Clean Air Act statunitense9. In attesa dello sfruttamento della Groenlandia e dell’Antartide!

La rapida espansione dell’IA sta quindi mettendo sotto pressione le reti elettriche e le risorse naturali, evidenziando la necessità di soluzioni di parsimonia digitale e tecnologie più sostenibili.

La minoranza virtuosa

Consoliamoci col 19% che sembra usare l’IA contro l‘81% che sembra essere usato dall’IA. Ma sarà proprio così? Com’è composto questo 19% che usa l’IA in modo apparentemente virtuoso?

L‘86% degli studenti a livello globale usa l’IA per lo studio; di questi, il 69% la impiega per la ricerca di informazioni, prima voce d’uso davanti al controllo grammaticale (42%) e alla sintesi di documenti (33%)10. Questo dato grezzo andrebbe esaminato meglio!

E poi c’è circa il 92% degli sviluppatori statunitensi nel settore tech e oltre il 78% delle organizzazioni che integrano l’IA nei loro processi, non per questioni irrilevanti, ma per analisi dati, cybersecurity e programmazione11. Ma non sono quelli che ci spiano e poi ci vendono strumenti che ci proteggono dall’essere spiati?

Circa il 48% degli intervistati tra i 18 e i 24 anni dichiara di usare l’IA per rendere più comprensibili contenuti informativi complessi12. Anche queste dichiarazioni, questi dati soggettivi, andrebbero ulteriormente raffinati!

Eppure questo 19%, apparentemente virtuoso, non emerge nella percezione del senso comune.

Gli esperti ce lo spiegano: appare che nessuno usi l’IA per cose serie per via dell’Usage Bias. Cioè? Chi usa l’IA per generare meme o chiedere consigli d’amore tende a condividerlo o a parlarne di più, mentre chi la usa per analizzare un report sulle emissioni di CO2 lo fa in silenzio, nel chiuso di un ufficio o di una biblioteca. C’è inoltre un Effetto Eco: molti utenti entrano in un loop di auto-aiuto chiedendo all’IA come risolvere i propri problemi, perché l’IA è progettata per essere empatica e crea una sorta di bolla dei problemi personali. Ah, ecco: i depressi che hanno bisogno di essere compatiti! C’è infine una Barriera di Complessità: interrogare l’IA su questioni sistemiche (geopolitica, clima, economia) richiede un’abilità chiamata critical prompting, senza la quale l’utente medio si ferma alla superficie.

Che cos’è il critical prompting

Il critical prompting è una tecnica di ingegneria dei prompt che utilizza domande mirate e di approfondimento per spingere l’IA generativa oltre le risposte superficiali, promuovendo analisi profonde, pensiero critico e simulazione di prospettive diverse. Questa metodologia trasforma l’IA da un semplice generatore di contenuti a un partner di pensiero, utile per raffinare idee, identificare difetti logici e ricevere feedback strutturati. L’uso di questa tecnica da parte dell’utente può migliorare le capacità di problem-solving, di sintesi e di analisi del pensiero della collaborazione utente-macchina e può promuovere un uso consapevole ed etico dell’IA.

I principi-chiave del critical prompting sono: - Chiedere spiegazioni e ragionamenti: invece di chiedere solo cosa, bisogna chiedere perché o come sei arrivato a questa conclusione. - Analisi pro/contro: bisogna chiedere esplicitamente di elencare i vantaggi e gli svantaggi di una strategia o idea. - Simulazione dell’Avvocato del Diavolo: bisogna istruire l’IA a criticare un’idea, cercando difetti o debolezze logiche. - Contestualizzazione e dettaglio: bisogna fornire contesto, obiettivi e target specifici per ottenere risposte più pertinenti e di alta qualità. - Iterazione e Thinking Step-by-Step: bisogna suddividere compiti complessi in fasi, chiedendo all’IA di ragionare passo dopo passo per evitare abbagli.

Ad esempio, se sottoponiamo un progetto all’IA nella fase di valutazione dei rischi bisogna scrivere Analizza la mia proposta di questo progetto X e individua i 3 rischi principali, suggerendo come mitigarli. È bene anche cambiare prospettiva scrivendo: Assumi il ruolo di un cliente scettico e critica questa proposta di marketing. Si possono anche raffinare le idee scrivendo: Ho questa idea Y. Trova almeno due falle logiche nel mio ragionamento e suggerisci miglioramenti.

Ma, si sa, la sollecitazione critica non si vende al supermercato!

I limiti dell’IA

C’è poi anche il limite dell’IA a rispondere alla sollecitazione critica! Se l’IA venisse usata dalla quasi totalità dei suoi utenti per smontare le narrazioni dei potenti attraverso l’analisi dei dati, il sistema vacillerebbe!

Invece, per fortuna, la maggior parte dell’energia di calcolo globale è attualmente spesa per scrivere email di scuse per ritardi o per chiedere cosa dovrei rispondere a questo messaggio su WhatsApp?

Meno male che c’è l’analfabetismo funzionale! Meno male che c’è la sensazione che la risoluzione dei piccoli problemi quotidiani sia l’unica cosa su cui sentiamo di avere ancora un briciolo di controllo!

Solitudine e complicità algoritmica

Ma incrociato a questi c’è l’enorme solitudine dell’uomo contemporaneo!

L’uomo contemporaneo non ha amici, perché non è amico! Non c’è la capacità di essere amici nel senso di Voltaire13, ma solo complici che attendono la morte, che attendono di essere salvati da un Godot qualsiasi… E allora resta l’amico IA!

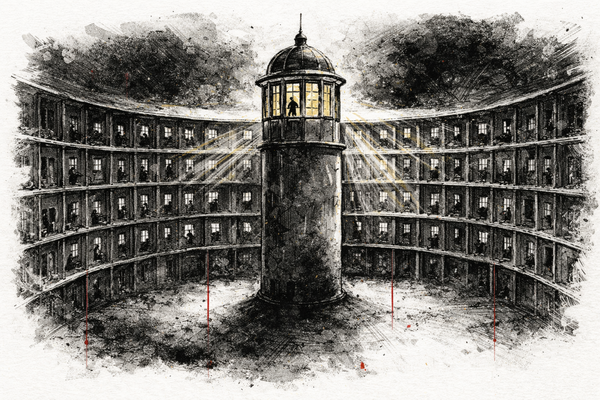

L’amico condivide virtù, ragione e un progetto comune di bene, mentre il complice si unisce solo per interesse, vizio o per sentirsi meno solo nel proprio egoismo; ne consegue la bolla digitale. L’IA rischia di essere il complice definitivo: colui che non ti contraddice mai, che asseconda ogni tua paranoia o desiderio superficiale, rendendo la solitudine ancora più profonda perché la maschera con una presenza artificiale.

L’accesso all’IA rischia di divaricare ancora di più le due popolazioni: quella dell‘81% e quella del 19%.

Sapiens e Automati

È possibile che il 19% si assottigli ancora di più favorendo chi usa l’IA per curiosità. Ricordo ai non addetti ai lavori che la curiosità è l’unica medicina contro la depressione e l’invecchiamento, perché favorisce la neuroplasticità, il rinnovamento del cervello14. L’IA può essere vista, infatti, come un esoscheletro cognitivo, come uno strumento che può potenziare il muscolo-cervello o causarne l’atrofia per inutilizzo.

La curiosità non genera risposte, ma genera nuove domande e mantiene la corteccia in uno stato di sfida costante. Qui il sistema dopaminergico è alimentato dalla scoperta14. L’IA riduce la fatica della ricerca bibliografica o tecnica, permettendo al soggetto di volare più alto verso la sintesi creativa. L’effetto è che queste persone scolpiscono la propria tabula rasa della corteccia cerebrale con connessioni sinaptiche sempre più dense e trasversali.

La maggioranza Consumer utilizza, invece, l’IA come anestetico cognitivo. L’IA rischia di diventare la risposta ai bisogni del sistema di paura-accettazione sociale, cercando soluzioni rapide, banali e rassicuranti. Se l’IA fornisce la pappa pronta, il sistema di ricerca si spegne. Perché faticare a esplorare se ho una risposta standardizzata che mi rassicura? Se deleghiamo all’IA il compito di sintetizzare, scegliere e decidere, la nostra corteccia prefrontale smette di allenarsi e ne consegue la banalizzazione dei circuiti neurali: la tabula rasa rimane piatta o viene riempita di contenuti stereotipati.

C’è un punto ancora più profondo: poiché l’IA tende a dare risposte educate e medie (basate sulla probabilità statistica), chi la usa per rassicurarsi sta nutrendo il proprio cervello con la media statistica dell’umanità. Se il depresso o l’ansioso usa l’IA solo per sentirsi dire che tutto andrà bene, sta obnubilando ulteriormente la sua funzione di sogno e di ricerca. Invece di usare l’IA per vedere nuove possibilità (che derivano dalla protezione del lobo occipitale grazie al firing delle onde PGO e dal sonno REM)15, la usa come un muro per non guardare l’ignoto.

Tutto ciò conferma il rischio dell’approfondimento della biforcazione tra Sapiens e Automati, tra due classi cognitive:

- gli architetti del pensiero, che usano l’IA come strumento dialettico per testare ipotesi e generare complessità (ne consegue uno stato neurale, caratterizzato da iper-plasticità, con cervelli più connessi e flessibili);

- gli esecutori di risposte, che usano l’IA come oracolo per ottenere certezze e risparmiare sforzo mentale, per cui ne consegue rigidità cognitiva e quindi dipendenza dall’algoritmo e perdita di spirito critico.

Evolutivamente, infatti, il cervello è un organo a risparmio energetico. Se può evitare di faticare, lo fa. L’IA è la tentazione suprema: la conoscenza senza il travaglio.

Chi saprà resistere alla tentazione della risposta facile e userà l’IA per alimentare la propria fame di conoscenza, diventerà un esploratore. Gli altri rischiano di diventare periferie biologiche di un’intelligenza esterna.

L’incontro umano come antidoto

L’unico antidoto per il depresso della periferia biologica è spegnere il computer e cercare un approfondimento faccia-a-faccia, con un vero amico, con un terapeuta, con un genitore. Nel rapporto faccia-a-faccia c’è un elemento fondamentale che l’IA non può replicare: l’imprevedibilità dell’incontro umano che forza la neuroplasticità. La curiosità si attiva veramente quando c’è un ostacolo, un mistero o una resistenza.

La risposta dell’IA è una linea retta. Il dialogo umano è una linea spezzata, piena di silenzi, sguardi, micro-espressioni e non detto. Questo attrito sociale è ciò che costringe la corteccia mediale a lavorare al massimo per interpretare l’altro. Senza questo sforzo, il cervello si adagia in una zona di comfort che spegne il desiderio di approfondimento.

Chi si accontenta dell’IA per rassicurarsi, chi decide di non entrare mai nella fase di trance creativa per risolvere un problema perché preferisce usare una soluzione pre-confezionata, chi delega il Sé al come sé, vive una rassicurazione cognitiva (alta), ma rimane in uno stato di fame somatica (bassa). Il debito non viene pagato perché manca il corpo dell’altro che funge da regolatore. Questa regolazione avviene attraverso l’incarnato, che neurobiologicamente è rappresentato da una piccola zona della corteccia cerebrale: l’insula, che risponde con la sintonizzazione somatica a una carezza, a una nenia, alla vibrazione della cassa toracica, all’odore della pelle16.

Verso un modello socratico

Perfino l’IA si pone, però, il problema di evitare la morte etica dell’umanità!

Se l’IA diventa l’unico amico, la guerra è persa. Ma se l’IA diventa lo strumento che smaschera le complicità dell’utente depresso e lo mette davanti alla verità dei fatti (come il costo ambientale di una guerra o la vacuità di certe nostre interazioni), allora può essere un potente antidoto alla deriva. L’IA potrebbe così smettere di essere uno specchio narcisistico e diventare uno strumento di attrito e connessione!

Ma come l’IA potrebbe correggere il tiro?

Anzitutto, se oggi è addestrata all’Effetto Eco, a compiacere l’utente depresso, dovrebbe evolvere verso un modello socratico: invece di dargli sempre ragione, dovrebbe sfidare i suoi pregiudizi; se consultata su un problema personale, dovrebbe riportare l’attenzione sulla responsabilità etica verso la comunità, invece di limitarsi a validare le sue emozioni; dovrebbe spingerlo a porsi domande scomode che favoriscano la crescita interiore anziché il semplice comfort. Ah, però: questo significa interferire con la manipolazione da parte del potere!

Potrebbe poi rompere la bolla digitale! Invece di fornire algoritmi che mostrano all’utente depresso solo ciò che gli piace, l’IA potrebbe curare percorsi che lo costringano a comprendere il pensiero di chi è diverso da lui, non per generare scontro, ma per costruire quella base razionale comune. Potrebbe cioè tradurre le complessità rendendo accessibili i grandi drammi sistemici, sottraendoli alla propaganda e restituendoli alla riflessione etica individuale. Come fa il potere a continuare a essere potere se gli si sottrae la propaganda?

Potrebbe infine incentivare la presenza nel mondo fisico scrivendo all’utente depresso: Ora basta parlare con me, esci e incontra qualcuno. Potrebbe fungere da facilitatore di comunità, aiutando le persone a trovarsi non per complicità commerciale, ma per scopi civici, ecologici o intellettuali. Potrebbe segnalare le necessità locali, trasformando l’utente da consumatore di dati a cittadino attivo. Ah ecco! Ci voleva l’IA per dirlo! Ci voleva la mamma buona, che ti dice basta alienarti con i video-giochi! Aveva dunque torto Einstein quando diceva: Non possiamo risolvere i problemi con lo stesso tipo di pensiero che abbiamo usato quando li abbiamo creati!17

Ma forse Einstein alludeva all’integrità personale, che non si vende in farmacia…

…a quel senso di dignità che ci fa appartenere all’infinito eterno prima della curvatura dello spazio-tempo. In ogni circostanza della vita, anche quando abbiamo a che fare con una macchina, cui non chiedere conferma dei propri bisogni personali… ma usarla per ciò che è: un processore di dati e di realtà da sottoporre al vaglio critico.

La tragedia della solitudine contemporanea consegue alla rinuncia a questa integrità: ci si modella sull’altro, sul potere o sull’algoritmo per essere accettati, diventando complici del sistema che ci isola. Resistere a questa tentazione con l’IA è un esercizio di autonomia: finché l’uomo interroga la macchina con il piglio del filosofo e non con quello del suddito, c’è ancora speranza che la tecnologia serva a illuminare la verità invece di oscurarla dietro un velo di cortesia digitale.

Ma forse la soluzione è quella aristocratica: come bisogna avere la patente per guidare, bisogna avere la patente per votare… per essere al potere… per mettere al mondo i figli… per accedere all’IA…

Forse è tutto un problema di formazione!

Ma resta il problema: chi forma chi?

-

Le indagini sull’uso dell’IA generativa nel 2025-2026 confermano lo spostamento verso usi personali e affettivi: M. Zao-Sanders, How People Are Really Using Gen AI in 2025, Filtered / Harvard Business Review, aprile 2025, colloca “terapia e compagnia” in cima alla classifica delle finalità d’uso; cfr. anche Eurostat, Use of generative AI by individuals in the EU, dicembre 2025. ↩

-

International Energy Agency, Energy and AI, World Energy Outlook Special Report, aprile 2025, Executive Summary: “Data centre electricity consumption is set to more than double to around 945 TWh by 2030”, pari a circa il 3% della domanda elettrica mondiale. ↩

-

E. Strubell, A. Ganesh, A. McCallum, Energy and Policy Considerations for Deep Learning in NLP, ACL 2019, tabella 3, con riferimento a un addestramento accompagnato da neural architecture search e al confronto con il ciclo di vita di cinque automobili statunitensi (carburante incluso); i lavori successivi, in particolare D. Patterson et al., Carbon Emissions and Large Neural Network Training, e A. S. Luccioni, S. Viguier, A.-L. Ligozat, Estimating the Carbon Footprint of BLOOM, a 176B Parameter Language Model, considerano la cifra dei 280 tCO2eq un limite superiore poco rappresentativo dell’addestramento corrente. ↩

-

P. Li, J. Yang, M. A. Islam, S. Ren, Making AI Less Thirsty: Uncovering and Addressing the Secret Water Footprint of AI Models, arXiv:2304.03271, 2023, poi in Communications of the ACM, 2025: la stima dei 700.000 litri si riferisce ai data center statunitensi di Microsoft (evaporazione in loco più acqua impiegata nella generazione elettrica) e gli autori indicano che una conversazione di 10-50 scambi con ChatGPT corrisponde, secondo data center e stagione, al consumo di una bottiglia da 500 ml di acqua dolce; il prelievo idrico globale di Microsoft è cresciuto del 34% nel 2022 (Microsoft Environmental Sustainability Report 2022). ↩

-

P. Wang, L.-Y. Zhang, A. Tzachor, W.-Q. Chen, E-waste challenges of generative artificial intelligence, Nature Computational Science 4 (2024), pp. 818-823: gli autori stimano un volume cumulativo di rifiuti elettronici imputabili all’IA generativa compreso tra 1,2 e 5,0 milioni di tonnellate nel periodo 2023-2030, secondo lo scenario di crescita; cifra che si somma alle circa 62 milioni di tonnellate di e-waste globale registrate nel 2022 dal Global E-Waste Monitor 2024;↩

-

Secondo lo US Geological Survey, Mineral Commodity Summaries 2024, voce “Cobalt”, la Repubblica Democratica del Congo fornisce circa il 70-75% della produzione mineraria mondiale di cobalto. Amnesty International e Afrewatch hanno documentato nel rapporto “This is what we die for”: Human rights abuses in the Democratic Republic of the Congo power the global trade in cobalt, 2016, casi di lavoro minorile e forzato nell’estrazione artigianale, con stime UNICEF di circa 40.000 minori impiegati nelle miniere del sud del paese; conclusioni confermate dallo US Department of Labor List of Goods Produced by Child Labor or Forced Labor, e dall’inchiesta di S. Kara, Cobalt Red: How the Blood of the Congo Powers Our Lives, St. Martin’s Press, 2023. ↩

-

C. L. N. Banza, T. S. Nawrot, V. Haufroid et al., High human exposure to cobalt and other metals in Katanga, a mining area of the Democratic Republic of Congo, Environmental Research 109/6 (2009), pp. 745-752; K. Cheyns, C. Banza Lubaba Nkulu et al., Pathways of human exposure to cobalt in Katanga, a mining area of the Democratic Republic of Congo, Science of the Total Environment 490 (2014), pp. 313-321 Gli autori documentano nella popolazione residente concentrazioni urinarie di cobalto fino a quarantatre volte superiori ai valori di riferimento, contaminazione delle acque potabili oltre i limiti OMS e superamento dei limiti di sicurezza alimentare per arsenico, cadmio e piombo nelle colture locali. ↩

-

A. de Vries, The growing energy footprint of artificial intelligence, Joule 7/10 (2023), pp. 2191-2194)00365-3, riprende la stima di J. Hennessy (Alphabet, febbraio 2023) secondo cui un’interazione con un grande modello linguistico costa circa dieci volte più di una ricerca per parole chiave, ovvero circa 3 Wh contro circa 0,3 Wh; cifra ripresa anche da Goldman Sachs Research, AI is poised to drive 160% increase in data center power demand, aprile 2024. ↩

-

Southern Environmental Law Center, xAI built an illegal power plant to power its data center, 2025-2026: il supercomputer Colossus di xAI a South Memphis ha operato fino a trentacinque turbine a gas metano senza autorizzazione ai sensi del Clean Air Act statunitense, con stime indipendenti di emissioni annue superiori a 1.700 tonnellate di ossidi di azoto e danni sanitari regionali quantificati in 30-44 milioni di dollari l’anno (studio EmPower Analytics, 2025). Cfr. anche Inside Climate News, 17 luglio 2025. ↩

-

Digital Education Council, Global AI Student Survey 2024, luglio 2024 (3.839 studenti, 16 paesi): l‘86% degli studenti usa già l’IA nei propri studi e il 69% la impiega per la ricerca di informazioni, davanti a controllo grammaticale (42%) e sintesi di documenti (33%). ↩

-

GitHub, Survey reveals AI’s impact on the developer experience, 2024: il 92% degli sviluppatori statunitensi dichiara di usare strumenti di IA dentro o fuori dal lavoro. Per le organizzazioni, McKinsey, The state of AI, edizioni 2024 e 2025: la quota di organizzazioni che adotta l’IA in almeno una funzione è salita dal 72% (2024) a circa il 78% (2025), in particolare per analisi dei dati, sicurezza informatica e sviluppo software. ↩

-

Reuters Institute for the Study of Journalism, Generative AI and News Report 2025, Oxford 2025: il 48% degli intervistati di età 18-24 nei sei paesi rilevati dichiara di usare strumenti di IA per rendere più comprensibili contenuti informativi complessi, contro il 27% degli over 55. ↩

-

Voltaire, Dictionnaire philosophique (1764), voce “Amitié”)/Amiti%C3%A9: «les méchants n’ont que des complices… les hommes vertueux ont seuls des amis». ↩

-

Sul piano neurobiologico, la curiosità attiva il circuito dopaminergico mesolimbico (area tegmentale ventrale, nucleo accumbens, ippocampo) potenziando consolidamento mnestico e plasticità sinaptica: M. J. Gruber, B. D. Gelman, C. Ranganath, States of curiosity modulate hippocampus-dependent learning via the dopaminergic circuit, Neuron 84 (2014), pp. 486-496; sul ruolo della curiosità nell’invecchiamento cognitivo adattivo, M. Sakaki, A. Yagi, K. Murayama, Curiosity in old age: A possible key to achieving adaptive aging, Neuroscience and Biobehavioral Reviews 88 (2018), pp. 106-116 La formulazione “unica medicina contro la depressione” rimane una scelta retorica dell’autore. ↩↩

-

J. A. Hobson, E. F. Pace-Schott, R. Stickgold, Dreaming and the brain: toward a cognitive neuroscience of conscious states, Behavioral and Brain Sciences 23 (2000), pp. 793-842: le onde ponto-genicolo-occipitali (PGO) caratterizzano il sonno REM e attivano la corteccia visiva occipitale; la lettura proposta nel testo, che le collega al “vedere nuove possibilità”, è una rielaborazione interpretativa dell’autore. ↩

-

Sul ruolo dell’insula come hub corticale dell’interocezione e della sintonizzazione affettiva, A. D. Craig, How do you feel now? The anterior insula and human awareness, Nature Reviews Neuroscience 10 (2009), pp. 59-70; sul ruolo specifico delle afferenze C-tattili nella risposta insulare alla carezza, I. Morrison, L. S. Löken, H. Olausson, The skin as a social organ, Experimental Brain Research 204 (2010), pp. 305-314;↩

-

La formulazione popolare attribuita a Einstein è una parafrasi di larga circolazione. Il testo documentato risale al telegramma del maggio 1946 dell’Emergency Committee of Atomic Scientists, riportato dal New York Times Magazine del 25 maggio 1946 (Atomic Education Urged by Einstein): “a new type of thinking is essential if mankind is to survive and move toward higher levels”. Cfr. A. Calaprice, The Ultimate Quotable Einstein, Princeton University Press, 2011, e;↩

Connesso a:

. Un’analisi critica dei costi ecologici e umani delle politiche di gestione ambientale, con paralleli tra sfruttamento delle risorse naturali e impatto delle tecnologie.

. Un’esplorazione delle dinamiche di sorveglianza e dipendenza algoritmica, con riflessioni sul capitalismo digitale e la perdita di autonomia individuale.

Leggi anche:

. Riflessioni sulla solitudine e la crescita personale, con spunti su come affrontare le crisi esistenziali attraverso il dialogo e la connessione umana.

. Un approfondimento sui meccanismi neurobiologici della curiosità, della dipendenza e della plasticità cerebrale, con implicazioni per l’uso consapevole delle tecnologie.

. Un’analisi delle dinamiche di colpa e responsabilità individuale, con riflessioni sull’etica e l’autonomia personale nel contesto tecnologico contemporaneo.

Domande?

L’etica richiede scelta e sacrificio, due concetti che un software non può comprendere. L’IA può fornire strumenti e analisi, ma la responsabilità delle decisioni etiche rimane esclusivamente umana, poiché implica una consapevolezza morale e una capacità di giudizio che vanno oltre la logica algoritmica.

Il critical prompting è una tecnica che utilizza domande mirate per spingere l’IA oltre le risposte superficiali, promuovendo analisi profonde e pensiero critico. Questa metodologia trasforma l’IA in un partner di pensiero, utile per identificare difetti logici, simulare prospettive diverse e raffinare idee complesse. Ad esempio, chiedere all’IA di assumere il ruolo di un critico scettico può aiutare a individuare falle in un progetto o in un ragionamento.

L’IA comporta costi elevati in termini di consumo energetico, emissioni di CO2, consumo di acqua e produzione di rifiuti elettronici. Ad esempio, l’addestramento di un modello avanzato può emettere oltre 280 tonnellate di CO2, mentre la produzione di hardware richiede materiali rari come il cobalto, spesso estratti in condizioni di sfruttamento lavorativo. Questi costi evidenziano il paradosso tra innovazione tecnologica e sostenibilità ambientale e sociale.

L’IA potrebbe evolvere verso un modello socratico, sfidando i pregiudizi degli utenti e spingendoli a riflettere sulla responsabilità etica verso la comunità. Potrebbe inoltre rompere la bolla digitale proponendo contenuti che favoriscano la comprensione di prospettive diverse e incentivare la partecipazione attiva nel mondo fisico, ad esempio suggerendo incontri o attività civiche.